A Visible Intelligence, um recurso de inteligência da Apple que a Apple introduziu no ano passado, possui alguns novos recursos no iOS 26 que o tornam mais útil e mais capaz de competir com a funcionalidade disponível em alguns smartphones Android.

Consciência na tela

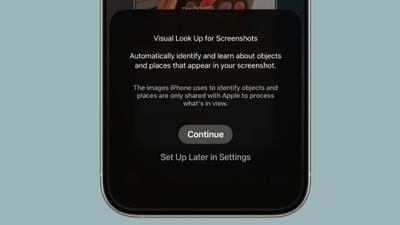

No iOS 18, a Intelligence visible funciona apenas com a câmera, mas em ios 26, também funciona com o que está no seu dispositivo. Você pode capturar uma captura de tela do que está na sua tela e depois usar a Inteligência visible ‘para identificar o que você está vendo, encontre imagens e obter mais informações através do ChatGPT.

Como obter o uso na consciência na tela para a inteligência visible

Inteligência visible Para capturas de tela, funciona quase o mesmo que Intelligence visible com o aplicativo de câmera, mas está localizado na interface de captura de tela. Pegue uma captura de tela (mantenha pressionado o botão de quantity e o botão lateral) e toque na interface de marcação, se estiver aparecendo.

Para sair da marcação (que é a visualização padrão), toque no ícone da caneta na parte superior da tela. A partir daí, você deve ver as opções latence ‘.

Destaque para pesquisar

Com o destaque para pesquisar a Intelligence visible ‘na tela de conhecimento de conteúdo, você pode usar um dedo para desenhar sobre o objeto na captura de tela que deseja procurar. É semelhante ao círculo do Android para pesquisar o recurso.

Destaque para pesquisar permite que você conduz uma pesquisa de imagem para um objeto específico em uma captura de tela, mesmo que haja várias coisas na imagem. Ele usa a pesquisa de imagens do Google por padrão, mas a Apple mostrou o recurso trabalhando com outros aplicativos como o Etsy durante seu evento principal. Os aplicativos provavelmente precisarão adicionar suporte ao recurso.

Em alguns casos, a Intelligence ‘identificará objetos individuais em uma imagem por conta própria e você pode tocar sem precisar usar o destaque para pesquisar. Isso é semelhante ao recurso de identificação de objetos no aplicativo Fotos, mas ainda leva a uma pesquisa de imagem.

Pergunte e pesquise

Se você não precisar isolar um objeto na sua captura de tela, basta tocar no botão Ask para fazer perguntas sobre o que está vendo. As perguntas serão transmitidas para o ChatGPT e o ChatGPT fornecerá as informações. O botão de pesquisa consulta o Google Search para obter mais informações.

Como na pesquisa visible padrão, se sua captura de tela incluir datas, horários e informações relacionadas para um evento, ela poderá ser adicionada diretamente ao seu calendário.

Identificação de novo objeto

A Apple não mencionou, mas a Inteligência visible adiciona suporte para identificação rápida de novos tipos de objetos. Agora ele pode identificar arte, livros, marcos, marcos naturais e esculturas, além dos animais e plantas sobre os quais foi capaz de fornecer informações antes.

Se você usar a Intelligence visible em um objeto que ele é capaz de reconhecer, verá um pequeno ícone brilhante. Tocar nele revela informações sobre o que está em vista. O que é interessante nesse aspecto de latence ‘é que ele funciona com a visão da câmera ao vivo ou com uma foto tirada.

Para solicitações de ASK e pesquisa padrão usando Intelligence visible, você deve tirar uma foto para que ela possa ser transmitida a fontes como ChatGPT ou Pesquisa de Imagem do Google. Arte, livros, pontos de referência, marcos naturais, esculturas, plantas e animais podem ser identificados no dispositivo sem entrar em contato com outro serviço.

Compatibilidade

Intelligence visible é limitado a dispositivos que suportam apple Intelligence, que inclui os modelos do iPhone 15 Professional e os modelos iPhone 16. Ele é ativado por um longo pressione no botão de controle da câmera em dispositivos que possuem controle da câmera ou usando o botão Ação ou uma alternância do centro de controle.

Knowledge de lançamento

Ios 26 está em testes beta agora, mas será lançado ao público em setembro.